Giovane praticante chiede aiuto a ChatGPT per una causa sul copyright e presenta in aula citazioni giuridiche inesistenti. Nessuna sanzione, ma arriva l’avvertimento: i tribunali non sono (ancora) pronti per l’intelligenza artificiale.

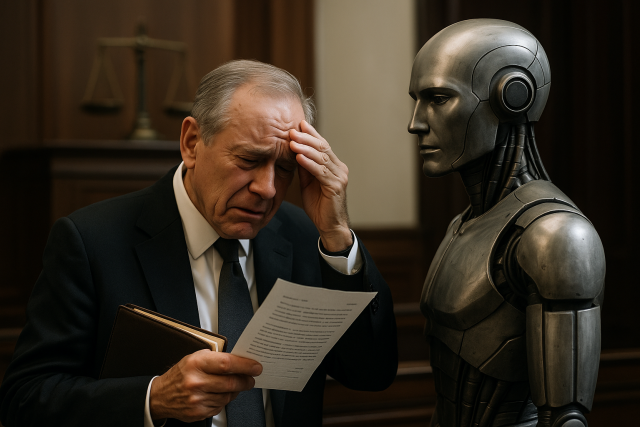

Il futuro della giustizia potrebbe anche parlare digitale, ma il presente – per ora – inciampa su un copia-incolla sbagliato. A farne le spese, stavolta, è stato un avvocato del foro di Firenze, ritrovatosi suo malgrado protagonista di una farsa giudiziaria 2.0. L’intento era nobile: cercare supporto in una causa di copyright. L’esecuzione, un disastro: l’AI consultata – nella fattispecie, ChatGPT – ha fornito una serie di sentenze della Corte di Cassazione che avrebbero potuto ribaltare la causa. Peccato solo che quelle sentenze non siano mai esistite.

A incappare nella trappola digitale sarebbe stata una giovane praticante dello studio, che si è affidata all’intelligenza artificiale senza confrontarsi con il proprio dominus. Il risultato? Una brillante arringa costruita su precedenti legali inventati di sana pianta. O, come ha sottolineato il tribunale nella sentenza del 14 marzo, “risultati errati” generati da “allucinazioni di intelligenza artificiale” – vale a dire: informazioni false presentate come vere, con tanto di riferimenti precisi, nomi, numeri di sentenza, date. Tutto falso. Ma plausibile.

Non si tratta di un caso isolato. Già nel 2023, un tribunale di New York aveva multato per 5.000 dollari uno studio legale colpevole di aver presentato documenti farlocchi generati da un’AI. Allora fu definito un “atto di consapevole elusione”. In Italia, per ora, la linea è più morbida: nessuna sanzione, solo un monito rivolto all’intera categoria forense.

«Il rischio non riguarda solo l’avvocato distratto – avverte Corrado Giustozzi, esperto di cybersicurezza – ma tutti noi. E se un giudice prendesse per buona una citazione falsa? Non bisogna sottovalutare quello che è successo». E a La Repubblica Giustozzi aggiunge: «Le intelligenze artificiali sono “bugiarde” perché progettate per fornire risposte plausibili anche quando non ne hanno, arrivando a inventare informazioni inesistenti quando necessario. Il problema è che non sono in grado di dire: “Mi spiace, non lo so”».

In un’epoca in cui l’AI si infila ovunque, dai compiti scolastici alle diagnosi mediche, i tribunali restano (o dovrebbero restare) un terreno minato. Le toghe, per ora, dovranno continuare a sporcarsi le mani nel codice civile vero. Non in quello scritto da un algoritmo con troppa fantasia.